最近在学习机器学习,想着边学习边分享的意思写了这篇文章,神经网络的介绍以及教程网络上已经有很多了,所以我这里也不去介绍了,今天我们手写一个神经元。

1、神经元是什么?

我这边从百科复制来了一段。

“人工神经网络通常呈现为相互连接的“神经元”,它可以从输入的计算值,并且能够机器学习以及模式识别由于它们的自适应性质的系统。”

可以看出神经网络是由若干个神经元组成的,而神经元的作用就是将输入转换成我们想要的输出。

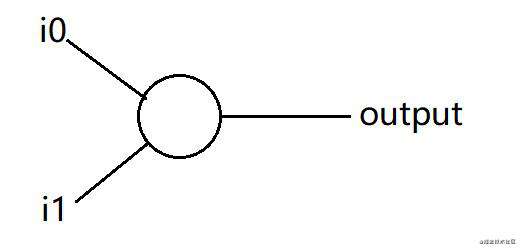

我们简单的画个示意图(如下图)

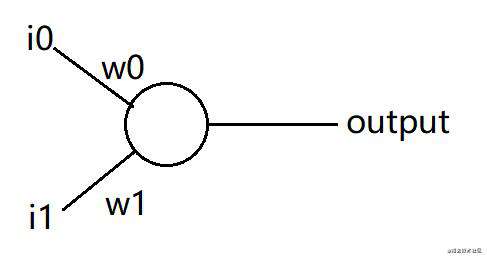

图中可以看出小圆圈是我们的神经元,i0,i1是我们的输入,output是我们的输出,然后我们再加上权重(如下图)。

权重是什么?这边举个例子。

小花,小红,小强经常去看电影,每次小花去了小强肯定去,因为小强喜欢小花,但有一天小强喜欢上了小红,小红去了小强才会去。

这就是不确定因素,每一个输入都会有一个权重,权重就是不断变化的值,我们不断地改变权重,让我们的结果预测的更好。

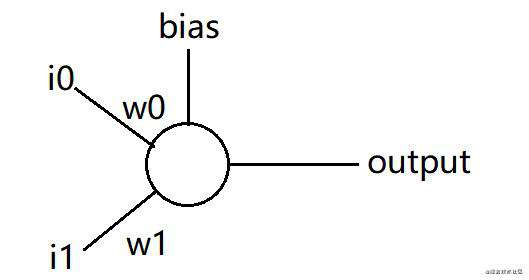

最后我们再加上偏置,每个神经元都有一个偏置(与线性方程 y=wx+b 中的 b 的意义是一致的,控制着函数偏离原点的距离),可以更好的拟合数据。(如下图)

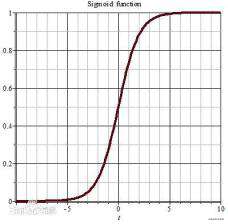

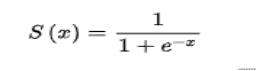

最后用线性回归公式计算我们的输出 output = i0 * w0 + i1 * w1 + bias,最后计算出来的结果可能很很大或者很小,这不是我们想要的结果,我们可以运用激活函数sigmoid,Sigmoid函数常被用作神经网络的激活函数,可以将变量映射到0,1之间。(如下图)

2.用代码来实现一下。

1.先定义下数据 左边是我们的输入,右边是我们的答案。可以看出这是个或运算,只要有一个是1答案就为1

const datas = [

[[1, 1], 1],

[[1, 0], 1],

[[0, 0], 0],

[[0, 1], 1],

];

输入有了,我们还需要权重和偏置,我们先初始化三个值,分别是两个权重跟一个偏置。

const random = []

for (i = 0; i < 3; i++) {

random.push(Math.random());

}

然后计算输出,我们之前说过了线性回归公式 output = i0 * w0 + i1 * w1 + bias

//计算输出

function output(datas) {

return output = datas[0] * random[0] + datas[1] * random[1] + random[2]

}

用Sigmoid函数将结果映射到0,1之间

//计算输出

function output(datas) {

let outputs = datas[0] * random[0] + datas[1] * random[1] + random[2]

return sigmoid(outputs)

}

//用Sigmoid将结果映射到0,1之间

function sigmoid(x) {

return 1 / (1 + Math.pow(Math.E, -x))

}

这样一个简单的神经元就写好了,但预测的结果肯定不对的,我们还得训练它!(重要的就在这!!!)

首先我们先写一个函数,来计算每次预测与答案的误差。

//计算我们的预测与答案的误差

function errorValue(output, result) {

return Math.abs(output - result)

}

然后我们定义我们的训练函数,有了误差,我就可以根据误差来调整权重的值为止。

function train(inputs, result) {

const devW = 0.001 //权重每次偏移多少

let error = errorValue(output(inputs), result),记录下此次的误差

dRandom = [], //上一次的权重

dError = null; //上一次的误差值

random.forEach((val, idx) => {

// 更改权重

random[idx] += devW

// 再次计算误差

dError = errorValue(output(inputs), result)

// 上一次误差减去这一次误差,看看我们的误差大了还是小了。

dRandom[idx] = (dError - error) / devW

//ps:有了两次的误差,我们可以知道,初始的权重与偏置,离目标值差多少。

//还原初始值

random[idx] = val

})

random.forEach((val, idx) => {

//减去误差值

random[idx] -= dRandom[idx]

})

}

这样就完成了,我们调试一下,先增加个死循环,如果错误率小于0.001,我们就跳出循环,并输出我们的权重跟偏置。

let a = 0, //计数

isBreak = false;//是否跳出循环

function train(inputs, result) {

const devW = 0.001 //权重每次偏移多少

let error = errorValue(output(inputs), result),// 记录下此次的误差

dRandom = [], //上一次的权重

dError = null; //上一次的误差值

random.forEach((val, idx) => {

// 更改权重

random[idx] += devW

// 再次计算误差

dError = errorValue(output(inputs), result)

// 上一次误差减去这一次误差,看看我们的误差大了还是小了。

dRandom[idx] = (dError - error) / devW

//ps:有了两次的误差,我们可以知道,初始的权重与偏置,离目标值差多少。

//还原初始值

random[idx] = val

})

random.forEach((val, idx) => {

//减去误差值

random[idx] -= dRandom[idx]

})

a++

// 每五万次输入一下

if (a % 50000 == 0) {

console.log(`运行:${a/50000}万次,错误率${error},预测答案${output(inputs)}`)

if (error < 0.001) {

isBreak = true

// 出我们的权重跟偏置

console.log(random)

}

}

}

for (i = 0; ; i++) {

datas.forEach(data => {

train(data[0], data[1])

})

if (isBreak) break

}

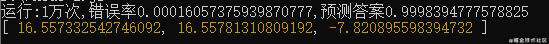

我们来看下运行结果

把我们的公式拿过来计算下。utput = i0 * w0 + i1 * w1 + bias

假如输入1 1

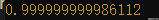

1x16+1x16-7=25 然后用sigmoid函数计算一下

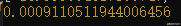

假如输入0 0

0x16+0x16-7=-7后用sigmoid函数计算一下

假如输入0 1

0x16+1x16-7=9后用sigmoid函数计算一下

可以看出答案都是比较理想的

由于只有一个神经元,能够做到的事情很少,但这并不是终点,一起加油吧。

常见问题FAQ

- 免费下载或者VIP会员专享资源能否直接商用?

- 本站所有资源版权均属于原作者所有,这里所提供资源均只能用于参考学习用,请勿直接商用。若由于商用引起版权纠纷,一切责任均由使用者承担。更多说明请参考 VIP介绍。

- 提示下载完但解压或打开不了?

- 找不到素材资源介绍文章里的示例图片?

- 模板不会安装或需要功能定制以及二次开发?

发表评论

还没有评论,快来抢沙发吧!